يشهد القطاع القانوني تحولا لافتا مع دخول الذكاء الاصطناعي على نطاق واسع في مكاتب المحاماة وأقسام الشؤون القانونية داخل الشركات، حيث تتجه المؤسسات إلى أتمتة المهام المعقدة وتقليل التكاليف ورفع مستوى الكفاءة، بحسب تقرير نشرته صحيفة

فاينانشال تايمز

ويثير هذا التوسع السريع نقاشا متزايدا حول الموثوقية والرقابة والمخاطر التنظيمية، خصوصا بعد حادثة بارزة في أستراليا أظهرت كيف يمكن للاستخدام غير المنضبط للذكاء الاصطناعي أن يقود إلى أخطاء قانونية جسيمة.

الذكاء الاصطناعي يقتحم مكاتب الشؤون القانونية

تشير فايننشال تايمز في تقريرها حول استخدام الذكاء الاصطناعي داخل الفرق القانونية إلى أن الشركات الكبرى بدأت اعتماد أدوات ذكية لأتمتة مهام كانت تستنزف وقتا وموارد ضخمة.

ومن أبرز هذه المهام: تحليل العقود، مراجعة الامتثال، تلخيص آلاف الصفحات من المستندات، وإجراء عمليات البحث القانوني المتقدمة.

ويؤكد التقرير أن هذا التحول ليس ترفا تقنيا، بل استجابة مباشرة لضغط العمل وتزايد التعقيدات التنظيمية، إذ توضح الشركات أن حجم البيانات القانونية بات يتجاوز قدرة الفرق القانونية التقليدية على معالجته في الوقت المناسب.

كما يرى مستشارون قانونيون أن الذكاء الاصطناعي يساعد في تحديد المخاطر بشكل أسرع ويتيح للمحامين التفرغ لاتخاذ القرارات الاستراتيجية بدلا من الأعمال التكرارية.

ومع ذلك، يشير التقرير إلى أن معظم المؤسسات لا تزال في مرحلة "الاختبار" وليس "الاعتماد الكامل"، في ظلّ قلق واضح من دقة النماذج اللغوية والالتزام بحماية البيانات السرية.

الذكاء الاصطناعي يدخل عالم التوظيف القانوني

كشف موقع Artificial Lawyer في تقريره حول شركة Mishcon de Reya البريطانية أن الذكاء الاصطناعي لم يعد مقتصرا على المساعدة في الأعمال القانونية، بل بات جزءا من عملية اختيار المحامين الجدد.

بدأت الشركة استخدام أداة Bright Apply لإجراء المقابلات الأولية عبر محادثة افتراضية يطلب من المتقدم التفاعل معها، ثم تحول إجاباته إلى نص يراجعه فريق التوظيف.

ويؤكد المكتب أن هذا النموذج يسهل تقييم أعداد كبيرة من المرشحين ويحسّن الشفافية، إذ يمكن تتبع كامل التفاعلات وتحليلها بصورة موضوعية. ويشير التقرير إلى أن 93% من المرشحين وصفوا التجربة بأنها "شخصية وذات صلة"، رغم كونها آلية بالكامل.

لكن هذه الخطوة أثارت بدورها جدلا داخل الأوساط القانونية حول مدى قدرة الذكاء الاصطناعي على تقييم مهارات المحامي، مثل الإقناع، والحدس القانوني، والاستدلال، وهي عناصر يصعب أن تقاس رقميا.

كما يخشى البعض من إمكان وقوع تقييمات غير عادلة نتيجة التحيز الخوارزمي أو سوء فهم السياق.

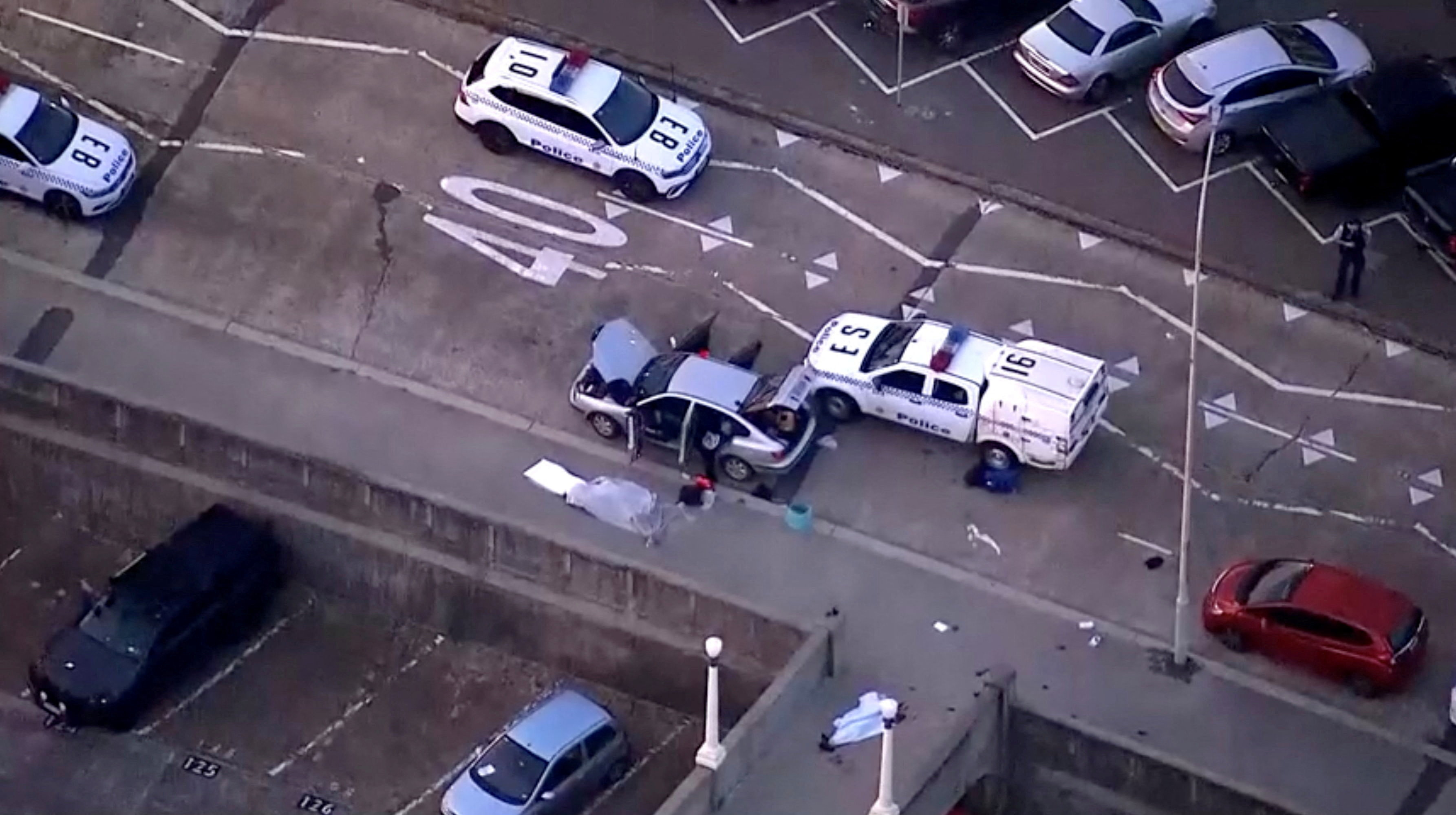

تشير ABC News Australia في تقريرها إلى حادثة لافتة أثارت جدلا واسعا داخل الوسط القانوني، حيث أحيل ثلاثة محامين إلى الجهات الرقابية بعد تقديمهم وثيقة قضائية احتوت على "استشهادات غير صحيحة" بسبب اعتمادهم على أداة ذكاء اصطناعي أنتجت مراجع قانونية غير موجودة.

وقالت المحكمة الفيدرالية ومحكمة الأسرة، في قرار مشترك، إن الوثيقة تضمنت "معلومات مضللة" نتجت عن "هلوسات الذكاء الاصطناعي"، وإنّ اعتماد المحامين على الأداة دون تدقيق بشري دقيق يشكل إخلالا بواجباتهم المهنية.

وفرضت المحكمة غرامات على أحد المحامين، مؤكدة أن سوء الرقابة الداخلية على استخدام الذكاء الاصطناعي يمثل خطرا على نزاهة القضاء.

كما حذرت المحكمة من أن إدخال مستندات قانونية في الأنظمة الذكية قد يؤدي إلى تسريب معلومات سرية وإلى الإضرار بحقوق الخصوصية، خصوصا في القضايا العائلية والمنازعات الحساسة.

وتظهر الحادثة أن الاعتماد على الذكاء الاصطناعي دون إنشاء سياسات واضحة للرقابة والمراجعة يمكن أن يعرض المحامين للمساءلة المهنية، وأن التوسع في استخدام الذكاء الاصطناعي يفرض على الجهات التنظيمية تحديث قواعد المهنة لتتوافق مع الواقع التقني الجديد.

هذا المحتوى مقدم من Blinx - بلينكس